最近、話題になっていたGemma4をローカルLLM環境で試そうと思い、LMStudioでGemma4系モデルをロードしたところ、なぜか「モデルのロードに失敗しました」というエラーが出てモデルを使用できませんでした。

結論から言うと、自分の環境では LM StudioのCUDA Runtimeを更新したことで解決しました。

同じ症状で困っている人向けに、環境やログを残しておきます。

環境

- GPU:RTX 5060 Ti 16GB

- OS:Windows 11

- LM Studio:0.4.12 (Build 1)

- 使用したローカルLLMモデル:

- Gemma4 E4B Q4_K_M

発生していた症状

Gemma4系モデルをロードすると、LM Studioで以下のダイアログメッセージが表示され、モデルのロードに失敗してLLMモデルが使えませんでした。

モデルのロードに失敗しました

試したこと

最初に以下を試しました。

- LM Studioを最新版へ更新

- モデルの再ダウンロード

- Gemma4の別の量子化モデルを試す

- コンテキスト量を調整

しかし、すべて効果なし。

そのうちLMStudioのVerが新しくなったら使えるかな?と思ってましたが、ダメ。

さすがにおかしいと思い、エラーログを解析しました。

解析したといっても、自分で詳しく調べたわけではなく、

AIにログをコピペして解析してもらっただけなんですけどね(笑)

原因はLMStudioのCUDA RutimeのVerだった

最終的に解決した方法はこれです。

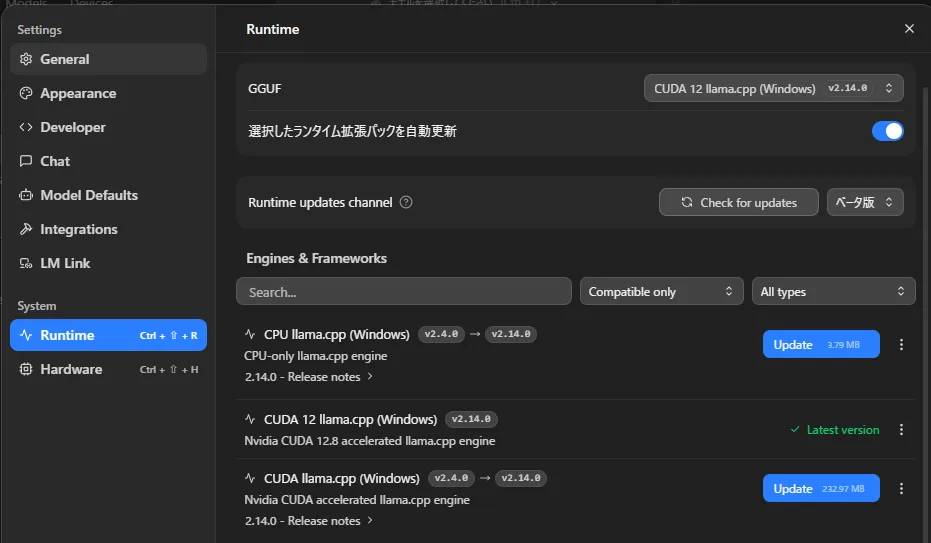

LM Studio → Settings → Runtime

ここからCUDAを更新しました。

更新後のバージョン:

- CUDA Runtime v2.14.0

これで、それまでロードできなかったGemma4モデルが正常にロードして使えるようになりました。

実際のモデルのロードに失敗した時のログ

ログを見ると、原因らしきメッセージが出ていました。

error loading model architecture: unknown model architecture: 'gemma4'さらに続けて、

failed to load modelつまり、当時のRuntime側がGemma4アーキテクチャを認識できていなかった可能性があります。

LM Studio本体を更新しただけでは改善しなかったので、Runtime側の更新が重要だったようです。

RTX50系ユーザーは注意かも

今回の環境は RTX 5060 Ti。

比較的新しいGPU世代なので、

- Runtime

- CUDA

- llama.cpp系バックエンド

このあたりの対応状況次第で不具合が出やすいのかもしれません。

特にGemma4のような新しめのモデルでは、

- 「ロード失敗」

- 「unknown model architecture」

- 「Failed to load model」

といった症状が出る場合、Runtime更新で解決する可能性があります。

同じ症状の人向けチェック項目

もしGemma4がロードできない場合は、まず以下を確認してみるといいかもしれません。

- LM Studio本体を更新

- Runtimeを更新

- CUDA Runtimeを最新版へ

- モデルを再ダウンロード

- 別量子化モデルを試す

特に今回のケースでは、

「LM Studio本体更新ではダメで、CUDAの更新で解決」

ここがポイントでした。

使用しているGPUについて

私の環境では RTX 5060 Ti 16GB を使用しています。

ローカル環境でAIを使うならVRAMが多い方がいいということで、これにしました。

RTX 5060 Tiを選んだ理由や、少しでも安く購入するためにやったことをこちらの記事にまとめています。

コメント